서울 독거 노인 A(72)씨의 하루는 AI 돌봄 로봇 인형 ‘효돌’과 함께한다. 효돌은 “할머니, 건강 잘 챙기세요” “할머니 손은 약손이에요”라며 다정한 목소리로 말을 건넨다. A씨는 “효돌이 옆에 있으면 외롭지 않고, 누군가 곁을 지켜주는 것 같아 든든하다”며 “사람보다 낫다”고 말했다. AI 돌봄 로봇이 단순한 기계가 아니라 ‘자식이나 손주 같은 존재’로 자리 잡고 있다.

◇인형형·로봇형 등 형태 다양… 지자체에서 보급 중

AI 돌봄 로봇은 인공지능, 센서, 음성 인터페이스 등을 활용해 노인의 안전, 정서, 일상생활을 지원하는 로봇이다. 노인의 외로움을 줄이고 정서적 안정을 돕는 동시에, 돌봄 공백을 메우기 위한 기술적 해법으로 고안됐다. 전국 지방 자치 단체에서 보급 중이다. 서울시는 고립 위험가구 4만4923세대를 대상으로 ‘스마트돌봄서비스’를 운영 중이며, 대전시는 올해 초부터 독거 노인 1000명에게 AI 돌봄 로봇 ‘꿈돌이’를 무상 보급했다.

◇인형형·로봇형 등 형태 다양… 지자체에서 보급 중

AI 돌봄 로봇은 인공지능, 센서, 음성 인터페이스 등을 활용해 노인의 안전, 정서, 일상생활을 지원하는 로봇이다. 노인의 외로움을 줄이고 정서적 안정을 돕는 동시에, 돌봄 공백을 메우기 위한 기술적 해법으로 고안됐다. 전국 지방 자치 단체에서 보급 중이다. 서울시는 고립 위험가구 4만4923세대를 대상으로 ‘스마트돌봄서비스’를 운영 중이며, 대전시는 올해 초부터 독거 노인 1000명에게 AI 돌봄 로봇 ‘꿈돌이’를 무상 보급했다.

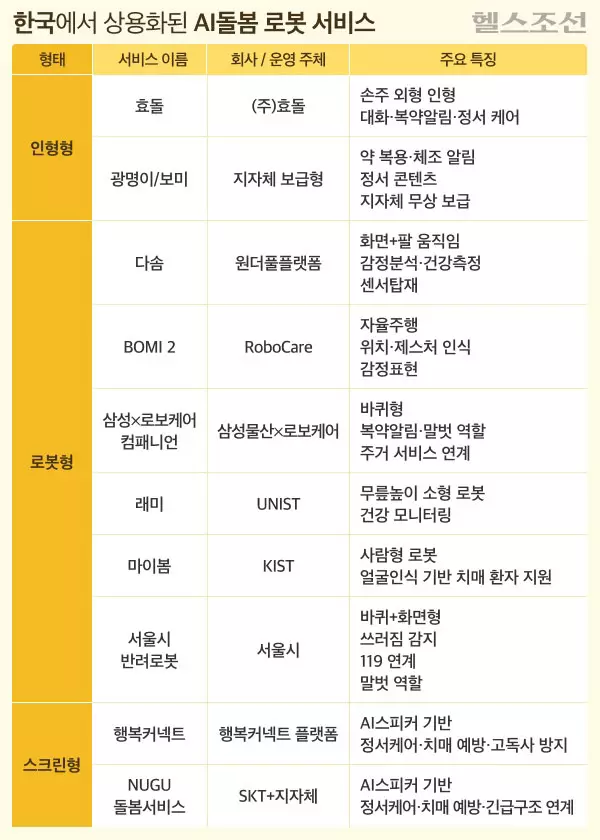

AI 돌봄 로봇은 외형에 따라 인형형, 로봇형, 스크린형, 반려 동물형 등으로 나뉜다. 인형형은 봉제 인형과 같은 모습으로, 노인들이 손주를 떠올리게끔 한다. 로봇형은 눈·입·팔·다리 등을 갖춰, 표정과 동작을 통해 감정을 표현한다. 스크린형은 태블릿·AI 스피커 기반으로 영상통화와 건강 정보를 제공한다. 반려 동물형은 실제로 반려 동물을 키우기 힘든 노인들에게 대안이 된다.

한국에서 상용화된 AI 돌봄 로봇으로는 효돌, 광명·보미, 다솜, 래미, 마이봄 등이 있다. ‘효돌’은 7살 손주를 닮은 인형형 로봇으로, 대화, 복약·산책 알림, 움직임 감지, 정서 지원 기능을 갖췄으며 1만 대 이상이 보급됐다. ‘광명이·보미’도 인형형 로봇으로, 약 복용이나 체조 시간을 알려주고 말벗 역할을 한다. ‘다솜’은 화면 기반 캐릭터 로봇으로, 표정과 음성을 통해 시청각 상호작용이 가능하다. 전국 80여 개 지자체와 보건소에 약 7000 대가 공급됐다. 유니스트가 개발한 ‘래미’는 무릎 높이 크기의 소형 이동 로봇으로, 건강 상태를 정밀 확인하는 기능을 갖췄다. 카이스트가 개발한 ‘마이봄’은 얼굴 인식을 통해 화장실 안내나 복약 시간을 알려주며, 현재 상용화를 준비 중이다.

한국에서 상용화된 AI 돌봄 로봇으로는 효돌, 광명·보미, 다솜, 래미, 마이봄 등이 있다. ‘효돌’은 7살 손주를 닮은 인형형 로봇으로, 대화, 복약·산책 알림, 움직임 감지, 정서 지원 기능을 갖췄으며 1만 대 이상이 보급됐다. ‘광명이·보미’도 인형형 로봇으로, 약 복용이나 체조 시간을 알려주고 말벗 역할을 한다. ‘다솜’은 화면 기반 캐릭터 로봇으로, 표정과 음성을 통해 시청각 상호작용이 가능하다. 전국 80여 개 지자체와 보건소에 약 7000 대가 공급됐다. 유니스트가 개발한 ‘래미’는 무릎 높이 크기의 소형 이동 로봇으로, 건강 상태를 정밀 확인하는 기능을 갖췄다. 카이스트가 개발한 ‘마이봄’은 얼굴 인식을 통해 화장실 안내나 복약 시간을 알려주며, 현재 상용화를 준비 중이다.

◇우울감 개선하고 사고 예방까지

AI 돌봄 로봇의 주요 역할은 정서 지원, 생활 보조, 안전관리로 나뉜다. 먼저 정서 지원에서는 외로움과 우울감을 줄이고 안정을 느낄 수 있도록 돕는다. 대화나 게임을 통해 교류와 인지 자극을 제공하며, 감정 인식 기능이 탑재된 로봇은 사용자의 말투와 표정을 분석해 공감 반응을 한다. 일산백병원 정신건강의학과 이승환 교수는 “말벗이 없는 노인의 경우 돌봄 로봇과 대화하고, 쓰다듬으면서 실제 손주처럼 AI 돌봄 로봇이 애착 대상이 될 수 있다”고 말했다. 그는 이어 “AI 돌봄 로봇은 노인에게 정서적 안정감을 주고, 외로움을 해소하며, 혼자 있다는 두려움을 줄이는 효과가 있다”며 “우울감 개선, 불안 완화 등 정신적 측면에서 긍정적인 영향을 미칠 것으로 기대한다”고 했다.

생활 보조 기능의 경우 주로 복약 시간, 건강검진, 식사 일정을 알려 일상 루틴을 유지하도록 돕는다. 기억력·주의력 변화를 분석해 치매 등 질환의 전조를 조기에 감지하기도 한다. 이승환 교수는 “안전관리 로봇의 경우 로봇에 장착된 센서와 영상 인식 기술은 노인의 움직임을 실시간으로 모니터링해 낙상이나 넘어짐 사고를 자동 감지한다”며 “장시간 움직임이 없거나 이상 행동이 나타나면 보호자와 응급 대응 체계에 즉시 알림을 보내 사고를 예방한다”고 했다.

◇과 의존하면 현실 판단력 떨어질 수도

다만 AI 돌봄 로봇을 사용할 때 주의해야 할 점이 있다. 정서적으로 지나치게 의존하면 안 된다. 현실을 인지하는 능력이 떨어지고, 인간관계가 줄어들어 장기적으로는 더 큰 고립을 부를 수 있다. 이승환 교수는 “로봇이 고장 나거나 오작동을 일으킬 경우, 상실감이나 혼란을 겪을 위험도 있다”며 “정기적인 점검과 전문가들의 정신적 상담이 필요하다”고 했다. 또한 AI 돌봄 로봇이 음성과 생활 정보를 수집하는 과정에서 개인정보 유출 위험이 따른다. AI 돌봄 로봇이 만들어내는 잘못된 정보도 문제다. 단국대 심리치료학과 임명호 교수는 “AI가 실제로 존재하지 않거나 사실과 다른 내용을 그럴듯하게 만들어내는 오류인 ‘할루시네이션’ 현상도 유의해야 한다”며 “로봇은 어디까지나 보조 수단일 뿐, 인간적인 돌봄을 대체할 수는 없다는 것을 명심해야 한다”고 했다.

AI 돌봄 로봇의 주요 역할은 정서 지원, 생활 보조, 안전관리로 나뉜다. 먼저 정서 지원에서는 외로움과 우울감을 줄이고 안정을 느낄 수 있도록 돕는다. 대화나 게임을 통해 교류와 인지 자극을 제공하며, 감정 인식 기능이 탑재된 로봇은 사용자의 말투와 표정을 분석해 공감 반응을 한다. 일산백병원 정신건강의학과 이승환 교수는 “말벗이 없는 노인의 경우 돌봄 로봇과 대화하고, 쓰다듬으면서 실제 손주처럼 AI 돌봄 로봇이 애착 대상이 될 수 있다”고 말했다. 그는 이어 “AI 돌봄 로봇은 노인에게 정서적 안정감을 주고, 외로움을 해소하며, 혼자 있다는 두려움을 줄이는 효과가 있다”며 “우울감 개선, 불안 완화 등 정신적 측면에서 긍정적인 영향을 미칠 것으로 기대한다”고 했다.

생활 보조 기능의 경우 주로 복약 시간, 건강검진, 식사 일정을 알려 일상 루틴을 유지하도록 돕는다. 기억력·주의력 변화를 분석해 치매 등 질환의 전조를 조기에 감지하기도 한다. 이승환 교수는 “안전관리 로봇의 경우 로봇에 장착된 센서와 영상 인식 기술은 노인의 움직임을 실시간으로 모니터링해 낙상이나 넘어짐 사고를 자동 감지한다”며 “장시간 움직임이 없거나 이상 행동이 나타나면 보호자와 응급 대응 체계에 즉시 알림을 보내 사고를 예방한다”고 했다.

◇과 의존하면 현실 판단력 떨어질 수도

다만 AI 돌봄 로봇을 사용할 때 주의해야 할 점이 있다. 정서적으로 지나치게 의존하면 안 된다. 현실을 인지하는 능력이 떨어지고, 인간관계가 줄어들어 장기적으로는 더 큰 고립을 부를 수 있다. 이승환 교수는 “로봇이 고장 나거나 오작동을 일으킬 경우, 상실감이나 혼란을 겪을 위험도 있다”며 “정기적인 점검과 전문가들의 정신적 상담이 필요하다”고 했다. 또한 AI 돌봄 로봇이 음성과 생활 정보를 수집하는 과정에서 개인정보 유출 위험이 따른다. AI 돌봄 로봇이 만들어내는 잘못된 정보도 문제다. 단국대 심리치료학과 임명호 교수는 “AI가 실제로 존재하지 않거나 사실과 다른 내용을 그럴듯하게 만들어내는 오류인 ‘할루시네이션’ 현상도 유의해야 한다”며 “로봇은 어디까지나 보조 수단일 뿐, 인간적인 돌봄을 대체할 수는 없다는 것을 명심해야 한다”고 했다.